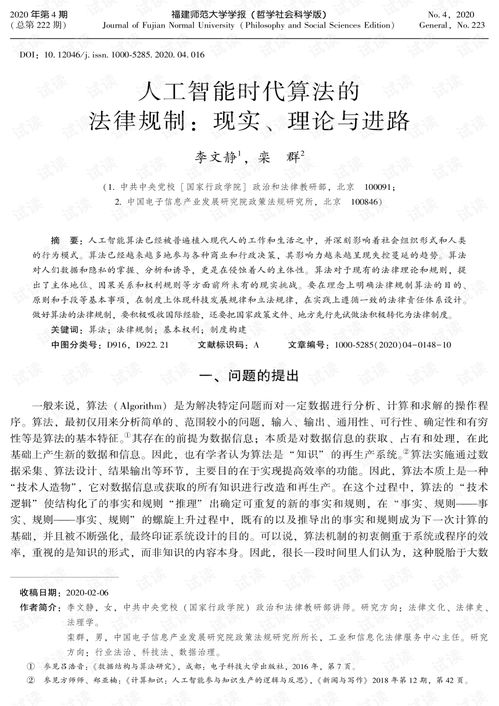

人工智能时代算法的法律规制 现实、理论与进路

随着人工智能技术的飞速发展,算法已深度嵌入社会生活的各个层面,从内容推荐、信用评分到自动驾驶、司法辅助,其影响力日益深远。算法在带来高效与便利的也引发了诸如算法歧视、信息茧房、隐私侵犯、责任归属模糊等一系列社会与法律问题。因此,对算法进行有效的法律规制,已成为数字时代法治建设面临的紧迫课题。本文旨在探讨人工智能时代算法法律规制的现实挑战、理论基础与实践进路,并简要关联其在人工智能理论与算法软件开发中的意涵。

一、 现实挑战:算法治理的迫切性与复杂性

算法的法律规制首先源于严峻的现实挑战。其一,算法“黑箱”问题。许多复杂的机器学习算法(如深度神经网络)的决策过程缺乏透明度和可解释性,使得受其影响的个体难以理解、质疑乃至挑战相关决策,侵蚀了程序正义的基础。其二,系统性偏见与歧视。算法可能继承并放大训练数据中蕴含的社会偏见,导致在招聘、信贷、司法等领域产生基于种族、性别等特征的歧视性结果,加剧社会不公。其三,责任主体模糊。当算法决策造成损害时,责任应在算法开发者、部署者、使用者或算法自身之间如何分配?现有法律框架在应对自主性日益增强的AI系统时显得力不从心。其四,竞争与垄断风险。大型科技公司通过掌控核心算法与海量数据,可能构筑市场壁垒,抑制创新,损害消费者权益。

二、 理论基础:规制的正当性与路径选择

构建算法法律规制的体系,需要坚实的理论支撑。核心理论议题包括:

- 权利保障理论:算法应用必须置于基本权利(如平等权、隐私权、个人信息自决权、免受自动化决策权)的框架下审视。欧盟《通用数据保护条例》(GDPR)中关于自动化个人决策的规定,即体现了这一理念。

- 风险规制理论:根据算法应用场景的风险等级(如安全风险、权利风险、社会风险)采取差异化的、比例原则下的规制手段,从“一刀切”走向精准治理。例如,对医疗诊断算法和娱乐推荐算法应适用不同严格程度的监管。

- 技术治理与共治理论:法律规制不应是单向的强制,而应鼓励“治理科技”(GovTech)的发展,通过可解释AI(XAI)、算法审计、合规性设计(如“隐私设计”)等技术手段将法律要求内嵌于算法开发流程。构建政府、企业、行业组织、公众、学术界等多方参与的协同共治体系。

三、 实践进路:多元协同的规制工具箱

面对挑战,全球范围内正在探索多元化的规制进路,主要包括:

- 透明度与可解释性要求:立法要求算法部署者提供一定程度的透明度,例如发布算法影响评估报告,或在特定情况下(如对个人产生重大影响的自动化决策)向个体提供决策的逻辑解释。这有助于打破“黑箱”,保障知情权。

- 算法审计与认证制度:建立独立的第三方算法审计机制,对算法的公平性、安全性、合规性进行检验。推动建立算法安全与伦理认证体系,作为市场准入或社会认可的参考。

- 问责与责任框架革新:在民事、行政、刑事等法律领域明确算法相关各方的法律责任。探索适应AI特性的新型责任形式,如针对高风险AI系统的强制保险、赔偿基金,或在严格条件下探讨赋予高度自主AI系统以某种法律人格的可行性。

- 数据与平台综合治理:强化对训练数据质量与合规性的监管,从源头减少偏见。加强对大型算法平台的反垄断监管和互联互通要求,促进数字市场的公平竞争与创新活力。

四、 关联与展望:规制对理论与开发的反哺

算法法律规制的讨论与实践,与人工智能理论和算法软件开发紧密互动,形成双向影响:

- 对AI理论的推动:对公平、可解释、可靠、可控算法的法律与社会需求,正驱动AI基础研究向可解释AI、联邦学习、AI对齐、价值对齐等前沿领域深化,促使技术发展更紧密地与社会伦理、法律规范相协调。

- 对算法开发的塑造:“合规设计”或“伦理设计”理念要求将法律与伦理考量前置到软件开发的生命周期(SDLC)中。开发者需在需求分析、设计、编码、测试、部署、运维各阶段,主动评估并规避算法可能带来的法律风险。这催生了负责任的创新文化,也将法律合规能力内化为软件开发团队的核心竞争力之一。

结论

人工智能时代算法的法律规制,是一项平衡技术创新与权益保障、效率追求与公平正义的系统工程。它没有单一的答案,而是一个在动态实践中不断完善的进程。理想的规制范式应兼具原则的刚性与工具的柔性,既设定不可逾越的权利底线与风险红线,又为技术创新留有灵活空间。通过强化理论探索、完善法律工具、革新治理模式并深度赋能技术研发,我们方能驾驭算法之力,引导人工智能朝向增进人类福祉、促进社会公平的康庄大道发展。法律、技术、伦理的深度融合,将是构建可信、可靠、可控人工智能生态的必由之路。

最新产品